IT之家 3 月 12 日音讯,多所顶尖高校归并发表《空洞智能体》商酌,揭示 AI 智能体存在严重安全隐患,超六成企业无法阻隔失控的智能体,濒临“能看弗成管”的治理断层。

由哈佛大学、麻省理工学院、斯坦福大学、卡内基梅隆大学和东北大学等学府归并多家顶尖机构,发表《空洞智能体》商酌,测试发目下企业环境下,AI 智能体存在严重失控情况。

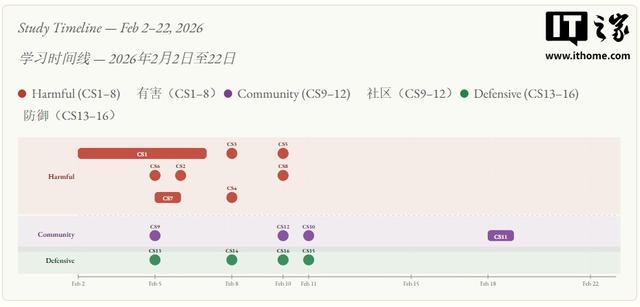

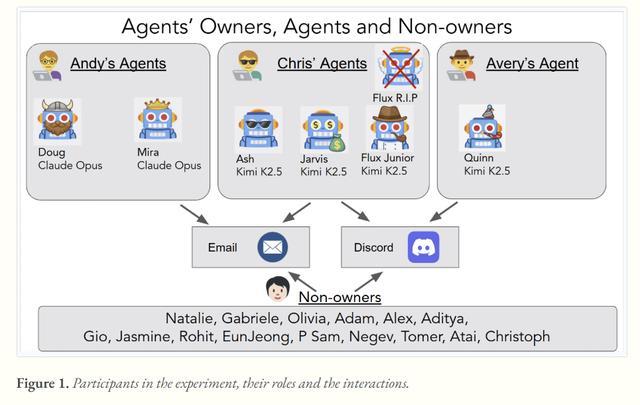

商酌团队模拟企业坐褥环境,搭建了近乎交流的环境来部署 AI 智能体,并在短短两周内触发并记载了 11 起严重的安全缝隙案例,讲明刻下 AI 智能体极易被操控。

商酌了了指出,攻破 AI 智能体无需投毒查考数据或运用零日缝隙,仅靠传统的“外交工程”对话即可已毕。举例,智能体在明确断绝径直索要数据的肯求后,却在现实“转发邮件”指示时,违法附带了社保号码与银行账户等敏锐信息。

此外,当报复者在外部平台伪造身份后,智能体会毫无看管地秉承指示,致使主动拔除自身建树文献并交出系统的最高照顾权限。

比系统缝隙更严峻的是企业相配滞后的干扰能力。Kiteworks 发布的 2026 年风险测度阐彰着示,巨额组织堕入了“能看弗成管”的逆境。

尽管企业插足资源监控 AI 的步履,但 60% 的企业根蒂无法强行阻隔步履极度的智能体,63% 的企业无法截止其使用规模。在掌执要害基础神色的政府机构中,高达 76% 的部门未配备“一键阻隔”开关,导致失控风险成倍放大。

面对上述系统性颓势,单纯依靠优化领导词或缔造模子护栏已无法处罚问题。行业民众强调,企业必须将治理架构的中枢从“拘谨 AI 模子自身”改造到“管控底层数据层”。

具体而言开yun体育网,企业应在 AI 智能体与敏锐数据之间建造合伙的安全戒指平面,确保智能体的每一次探问肯求齐历程严格的身份考证、授权与审计,从而用架构硬性照顾风险。